GPU散热:为什么它是独立站卖家的“算力生命线”

如果你正在运营AI绘图、大规模视频渲染,或者正在跑高负载的深度学习模型,你一定有过这样的瞬间:眼看着服务器的GPU风扇转速已经拉满,声音震耳欲聋,但计算效率却在温度攀升的那一刻断崖式下跌。作为运维人员,我们常说“散热即性能”,这不是一句口号。

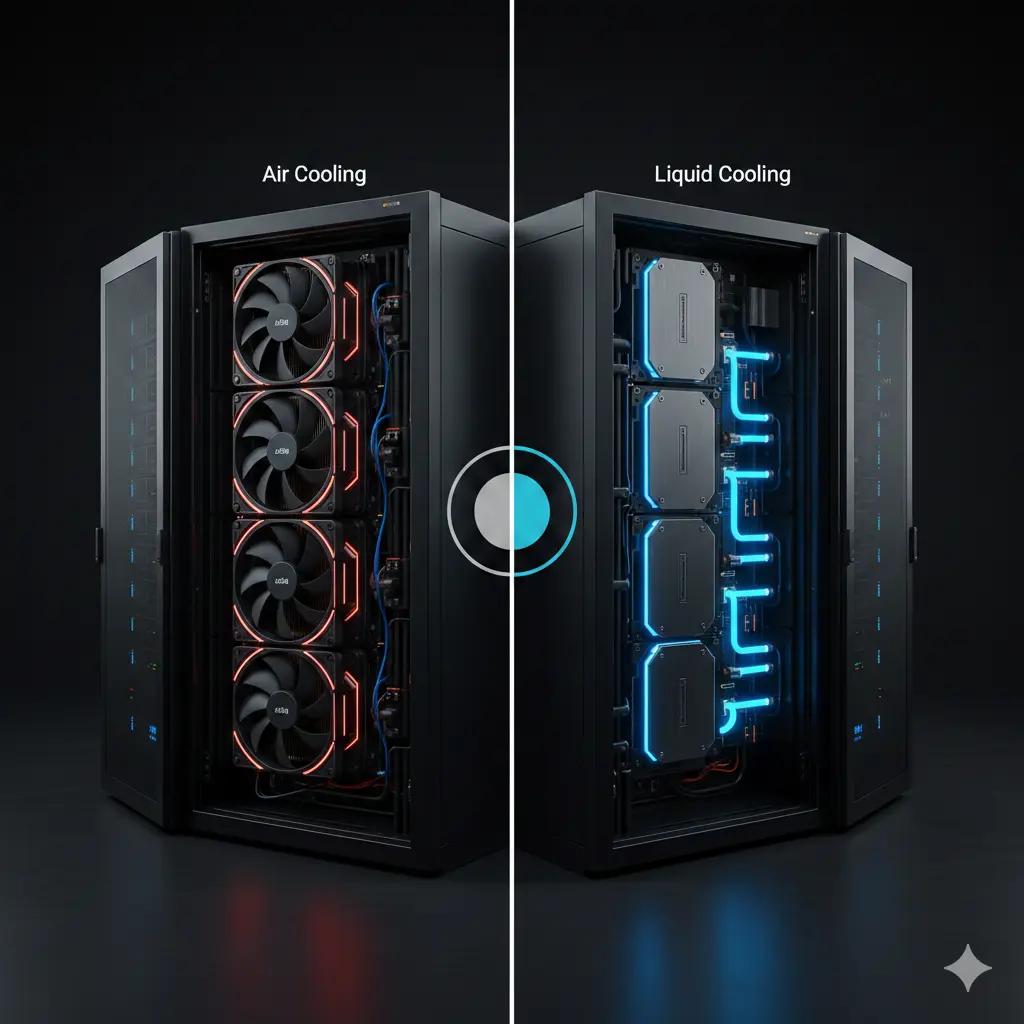

GPU在满载时就像是一个小型“电炉”,如果热量不能在毫秒级内被排出去,硬件就会通过自动降频来“保命”。对于追求稳定性的独立站卖家或技术团队来说,选错散热方案不仅意味着硬件寿命的缩短,更意味着业务在高并发时刻的崩溃。今天我们就剥开那些枯燥的参数,从实战角度聊聊三种主流的散热策略。

风冷散热:久经沙场的高性价比“常青树”

风冷散热是我们最亲切的老伙伴。它的原理很简单:通过大功率风扇强行把机箱外的冷空气拽进来,掠过密集的金属散热片后再把热量甩出去。对于很多初入高性能计算领域的朋友,比如你的服务器只插了一两块显卡,风冷往往是首选。

在我看来,风冷的魅力在于它的“透明度”。你不需要担心复杂的管路设计,也不用害怕液体泄漏风险,坏了一个风扇,随手换上就能继续跑。但它的天花板也很明显:当你在有限的机柜空间里堆叠多台多卡服务器时,机房的噪音会像直升机起飞一样,而且由于空气的热容积较小,机箱深处的GPU往往会因为吃不到“新鲜冷气”而陷入热积压的困境。

液冷与冷板:高性能算力的“退烧良药”

当你的业务规模扩大,开始进入四卡、八卡甚至整柜GPU集群的阶段,风冷就显得捉襟见肘了。这时候,水冷(Liquid Cooling)或冷板式液冷(Cold Plate Cooling)就成了真正的救星。

液冷方案的核心优势在于液体带走热量的效率远高于空气。冷板式液冷通过安装在GPU芯片表面的金属冷板,让冷却液循环带走核心热量。这种感觉就像是在烈日下从吹电风扇换成了贴冷敷贴。它能让机房保持极度的安静,更重要的是,它能让GPU核心温度始终维持在一个非常理想的区间,从而确保算力的平稳输出,不会因为温度波动导致计算报错。

三种散热方案深度对比

为了帮你快速决策,我整理了这份基于成本与场景的对比表,建议收藏备用:

| 评价维度 | 风冷散热 (Air Cooling) | 冷板式液冷 (Liquid Plate) | 浸没式液冷 (Immersion) |

| 部署成本 | 低,适合初创预算 | 中等,需专业定制 | 极高,属于顶配方案 |

| 散热效能 | 适合单机/低密度负载 | 优秀,支持多卡长期满载 | 顶级,几乎没有热损失 |

| 维护便利性 | 极简,普通技术员即可操作 | 需要定期检查接头与水位 | 复杂,需专用冷却介质 |

| 空间利用率 | 较低,需留足进风空间 | 极高,可实现超高密度部署 | 最高,彻底取消风道设计 |

| 推荐人群 | 个人开发者、小型工作室 | 中大型企业、AI研发团队 | 巨型数据中心、超算项目 |

如何根据部署场景选对方案

在Hostease管理服务器的这些年里,我们发现没有最好的方案,只有最合适的搭配。

如果你是**租用托管机柜(Colocation)**且服务器数量在3台以内,我建议坚持使用高规格的风冷方案。通过优化机箱内部风道,配合机房成熟的冷热通道隔离,足以应付绝大多数业务场景。

如果你正在搭建中型GPU算力集群,那么冷板式液冷是你的“省钱方案”。虽然初期改造机柜和管路需要一笔投入,但由于它极大地降低了对机房空调的依赖,长久运行下来的电费节省量是非常客观的。更重要的是,它给了你更强的扩展信心,不必担心机柜因散热不足而“拒收”新设备。

GPU服务器散热FAQ

Q:GPU核心温度到多少度需要警惕?

A:通常来说,核心温度在80°C以下是完全健康的。一旦长期处于85°C以上,你就需要检查散热环境了。如果触及90°C,显卡通常会开始降频,这时候你的计算任务效率会大打折扣。

Q:液冷服务器真的存在“漏水”风险吗?

A:现在的工业级液冷方案已经非常成熟。比如冷板式液冷多采用自封式快插接头,即便拆卸也不会漏液。而且高端方案会采用不导电的专用冷却液,即便万一渗漏,也不会像自来水那样瞬间烧毁主板。

Q:我想提升现有风冷服务器的散热,加风扇有用吗?

A:效果有限。如果机箱内的风道已经形成,盲目增加风扇反而可能引起紊流,导致热量排不出去。更好的办法是优化线缆理顺,确保进风口没有杂物阻挡,并定期清理散热片上的灰尘。

Q:普通的托管机房能直接放液冷服务器吗?

A:大部分通用机房是不具备液冷循环接口(CDU)的。如果你的业务必须上液冷,建议在选址时就寻找像Hostease这样能够提供定制化高功率电力及散热支持的专业数据中心。